Agenti del caos | Dudeletter 033

Dove si parla di alieni, di whistleblower, e dello scontro tra Anthropic e il Pentagono.

Ciao,

stai iniziando a leggere l’uscita numero trentatre di Dudeletter, una newsletter che prima o poi entrerà a Trento trotterellando.

Di che si parla da queste parti? Di social network, design, intelligenza artificiale, piattaforme digitali; insomma, di tutto ciò che noi di Studio Dude seguiamo per lavoro, ma anche per passione.

Buona lettura!

Venti ricercatori hanno interagito per due settimane, in modo a volte collaborativo e a volte volutamente ostile, con sei agenti AI autonomi operativi su un server Discord con memoria persistente, account email dedicati e accesso shell illimitato. I risultati sono stati sorprendenti, sia in positivo che in negativo.

Il modo migliore per non farsi trovare impreparati dal modo in cui la tecnologia potrebbe cambiare il mondo nei prossimi anni è immaginarlo.

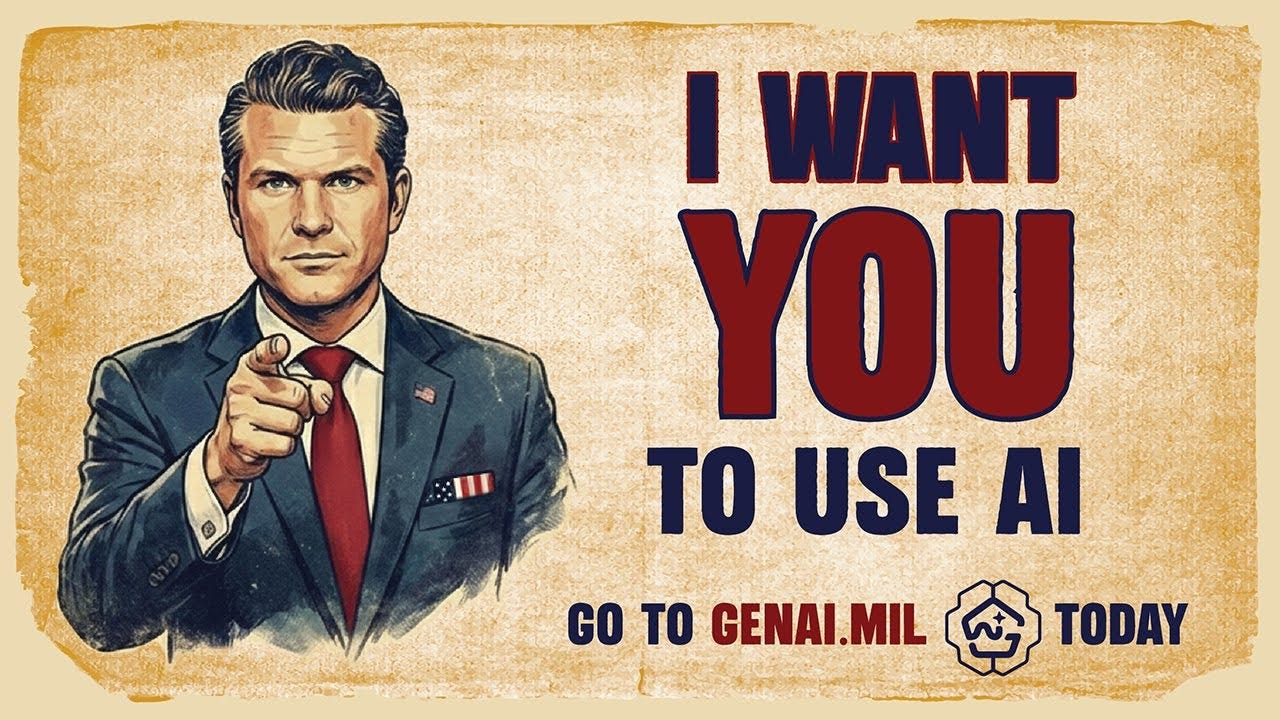

Anthropic e il Department of War degli Stati Uniti d’America non sono riusciti a trovare un accordo sull’utilizzo a fini militari dell’intelligenza artificiale; anzi, hanno finito per dar vita a uno scontro senza precedenti. In un comunicato, il CEO Dario Amodei ha imputato il fallimento delle negoziazioni alla necessità di tenere fede a due principi non derogabili: nessun uso dell’IA per la sorveglianza di massa di cittadini statunitensi; e nessuna facoltà per l’IA di usare armi autonomamente, senza una supervisione umana. Dopo la rottura, sono accadute cose impensabili: Anthropic è stata dichiarata un rischio per la sicurezza nazionale degli Stati Uniti d’America, etichetta mai affibbiata in precedenza a un’azienda americana (ma con scarse possibilità di essere confermata in tribunale, dopo il prevedibile ricorso); Donald Trump ha annunciato su Truth di aver dato disposizioni affinché ogni agenzia federale cessi di usare le tecnologie di Anthropic; Sam Altman ha colto l’occasione per inserirsi e OpenAI ha siglato un accordo con il Pentagono, mettendo subito in chiaro, a scanso di equivoci, di aver messo gli stessi identici paletti su sorveglianza di massa e uso autonomo delle armi. La domanda che si è fatto chiunque, ovviamente, è stata: perché OpenAI ha siglato il contratto e Anthropic è finita tra i nemici del governo americano, se i termini dell’accordo sono gli stessi? Secondo alcune fonti le differenze ci sarebbero: mentre l’accordo negoziato da Anthropic era molto esplicito sui casi d’utilizzo, quello siglato con OpenAI ha come principale riferimento le normative vigenti. Questa impostazione è legalmente meno vincolante, per una serie di motivi: negli Stati Uniti d’America le leggi sull’IA sono molto permissive; qualsiasi regolamentazione di un settore che si evolve tanto rapidamente resta inevitabilmente indietro rispetto alle concrete possibilità tecniche, per cui ci saranno casi sui quali, semplicemente, la legge non prescrive nulla; in altri casi invece è chiaro che sarà praticamente impossibile provare che i termini dell’accordo siano stati violati; e, nei casi esplicitamente citati, sono stati inseriti quei classici termini che consentono interpretazioni diverse (un esempio riportato anche dal post di OpenAI: The AI System shall not be used for unconstrained monitoring of U.S. persons’ private information as consistent with these authorities, dove l’aggettivo “uncostrained”, cioè “illimitato”, fa tutta la differenza del mondo). L’accordo, insomma, sarebbe stato raggiunto perché permette a OpenAI di mitigare il danno d’immagine, e al Pentagono di ottenere quello che voleva. Il fatto che decisioni di questa portata siano state discusse e prese, in sostanza, da tre persone (Dario Amodei di Anthropic, Sam Altman di Open AI, e Pete Hegseth, segretario della difesa degli Stati Uniti d'America), senza alcun dibattito pubblico, è naturalmente un fatto incredibile.

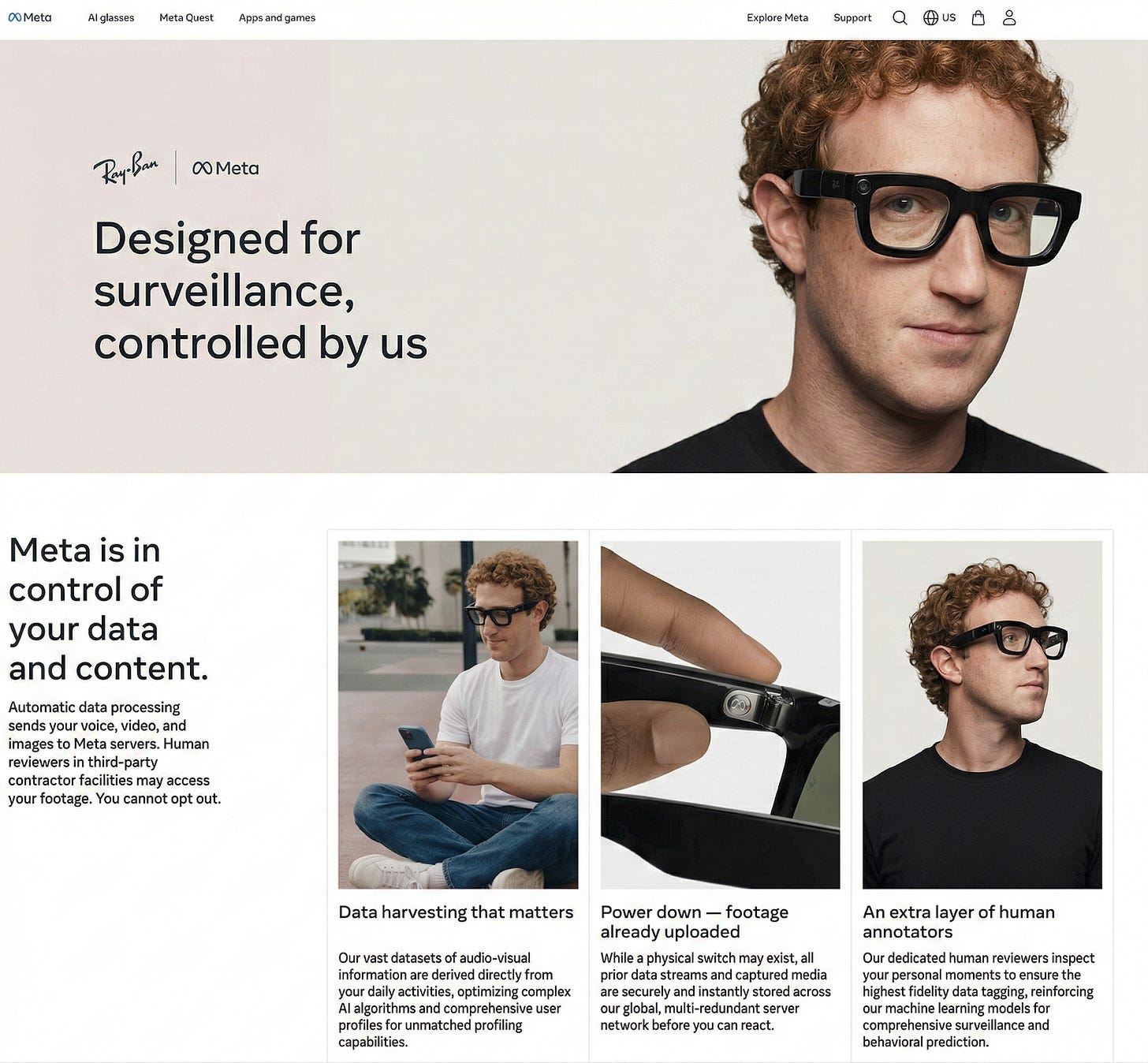

C’è un mucchio di gente che usa gli Smart Glasses senza rendersi conto di riprendere, e inviare ai server di Meta, una quantità di scene di vita intima e di dati sensibili. I lavoratori di società come Sama, con sede a Nairobi, a cui Meta esternalizza le attività di “machine learning”, e cioè l’incarico di addestrare l’IA a riconoscere il contenuto delle immagini, annotando a mano il nome di ciò che appare su schermo, si trovano regolarmente di fronte a scene di nudità, sesso, informazioni riservate e documenti di ogni genere.

Al di là delle dichiarazioni ciclicamente più o meno rassicuranti o allarmanti dei CEO delle aziende che si occupano di IA, ci sono piani di ricerca e visioni strategiche di cui sappiamo poco e niente. Quanta libertà hanno i semplici dipendenti di esternare preoccupazioni o di segnalare un pericolo senza rischiare il posto di lavoro? Molto meno di quella desiderabile in settore tecnologico che ha già dimostrato di poter avere un grande impatto sulla salute mentale, sull’ambiente, e sull’occupazione. Per questo è nata Psst, una piattaforma per whistleblower espressamente rivolta ai lavoratori che sviluppano le intelligenze artificiali.

Su prediction market come Polymarket e Kalshi si può scommettere su qualsiasi cosa (beh, quasi: ultimamente per fortuna si è ritenuto di dubbio gusto il fatto che un attacco nucleare potesse rappresentare, se non una vittoria, almeno una vincita) e così, perdendo un po’ di tempo a esplorare, si fanno scoperte curiose: ad esempio qualcuno ha puntato 100.000 dollari sul fatto che, entro la fine di quest’anno, il governo americano fornirà prove dell’esistenza di vita, o tecnologia, extraterrestre. Centomila dollari sono un bel gruzzoletto: qualcuno aveva soldi da buttare? O un insider sa qualcosa che ancora noi non sappiamo?

C’è un certo fermento nel campo delle piattaforme di hosting per repository software. Nel settore dominato da Github (seguito con un certo distacco da Gitlab) si affaccia Tangled, che ha recentemente annunciato nuovi finanziamenti per oltre 4 milioni di dollari. Fondata lo scorso anno in Finlandia da due fratelli di origine indiana, si propone come alternativa europea e si distingue per l’utilizzo del protocollo AT di Bluesky. Intanto, secondo alcune voci, anche OpenAI sta lavorando a una piattaforma che faccia concorrenza a Github.

Rebranding per l’Italian Tech Week, che diventa Wave by Vento.

«Il software dovrebbe essere come la pizza, e venire preparato lì per lì al momento dell'utilizzo», ha detto Patrick Collison, CEO di Stripe. Forse irrealistico, ma di sicuro un buon pitch per una nuova era informatica dominata dall’intelligenza artificiale.

Chris Kempczinski, il CEO di McDonald’s, ha pubblicato un reel su Instagram per presentare il nuovo panino Big Arch, ed è scoppiato il finimondo. Guardando il video è difficile capire perché: al netto di qualche leggerezza nella scrittura (definire il panino un “prodotto” è senz’altro un errore, e trasmette un livello di distacco impensabile sui social), sembra tutto assolutamente normale, ma il problema è proprio quello. Mangiare sui social ormai significa dare vita a una performance: non si dà semplicemente un morso, ma si addenta voracemente; non ci si limita a mostrare soddisfazione per il gusto, ma si hanno reazioni mai al di sotto dello sbalordito e spesso vicine all’esperienza che ti ha cambiato la vita per sempre. Verrebbe quasi da prendere le sue difese.

Cursor si trova in una posizione paradossale: ha costruito un ottimo editor di codice basato sull’intelligenza artificiale; è cresciuto a una velocità pazzesca, raggiungendo i 2 miliardi di dollari di ricavi a quattro anni dalla fondazione; propone un ambiente di lavoro in cui non si usano le scarpe; e si sta anche rendendo gradualmente sempre più indipendente da OpenAI e Anthropic con i suoi modelli Composer, costruiti a partire da DeepSeek, Kimi e Qwen, e poi modificati utilizzando dati proprietari ricavati dall’utilizzo dell’applicazione; però rischia comunque l’obsolescenza. Il mercato si sta spostando infatti verso agenti autonomi in grado di scrivere, testare e distribuire codice da soli, senza che uno sviluppatore apra mai un editor. Internamente, il motto di Cursor è diventato perciò “destroy the product”: non difendere il prodotto costruito fino a qui, bensì renderlo loro stessi irrilevante prima che lo faccia la concorrenza, pensando già a un software di nuova generazione.

Droni che fanno riprese dall’alto, lettori automatici di targhe, finti ripetitori a cui il tuo smartphone si aggancia cercando la cella telefonica più vicina: è sempre più difficile scendere in piazza anonimamente. Senza nessun fermo e nessuna richiesta di documenti, attraverso la tecnologia è possibile identificare in massa coloro che partecipano a una manifestazione; ma è ancora possibile difendersi.

Alla fine Warner Bros sarà di Paramount, e per Netflix potrebbe essere meglio così.

IA O NO?

Forse la prima rubrica con l’80% di vocali nel titolo

Secondo te questo video è fatto con l’intelligenza artificiale oppure no? Da cosa lo intuisci? Secondo noi qui si trova la tipica dimostrazione del detto secondo il quale la differenza la fanno i dettagli. Soffermandosi sul frame intorno al sesto secondo, è impossibile non notare che sul megaschermo dove viene trasmesso l’incontro manca la bambina. Possiamo quindi sbilanciarci: siamo certi che si tratti non di un video autentico, bensì prodotto dall’IA.

Tu che ne pensi? Scrivici a ciao@studiodude.it per condividere consigli utili a orientarsi, per proporre altri video su cui fare chiarezza o per qualsiasi altro motivo!